Хакеры из Китая, России и Ирана обманывают жертв с помощью OpenAI, заявила Microsoft

Хакеры из России, Китая и Ирана, поддерживаемые государством, используют инструменты OpenAI от Microsoft для оттачивания своих навыков и обмана своих целей, говорится в докладе, опубликованном в среду.

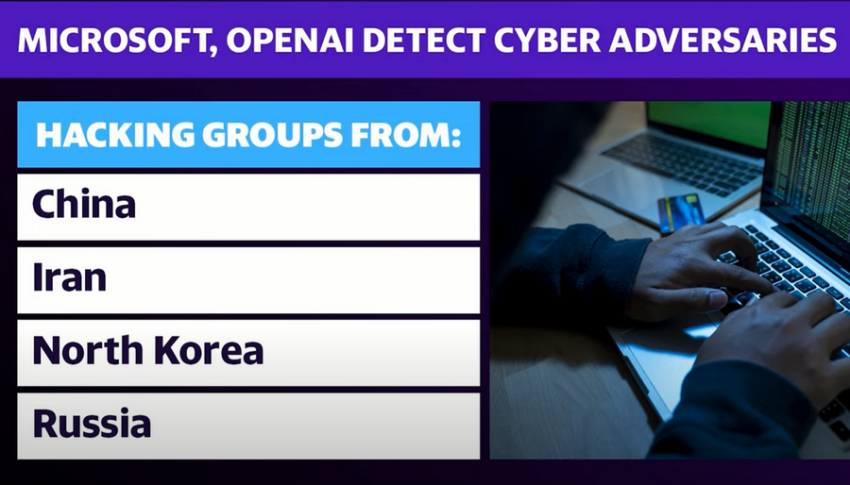

В своем отчете Microsoft сообщила, что отслеживала хакерские группы, связанные с российской военной разведкой, иранской Революционной гвардией, а также правительствами Китая и Северной Кореи, когда они пытались усовершенствовать свои хакерские кампании с помощью больших языковых моделей. Эти компьютерные программы, часто называемые искусственным интеллектом, используют огромные объемы текста, чтобы генерировать ответы, похожие на человеческие.

Компания ввела полный запрет на использование ее продуктов искусственного интеллекта хакерскими группами, поддерживаемыми государством.

"Мы просто не хотим, чтобы те субъекты, которых мы идентифицировали — которые, как мы отслеживаем и знаем, являются субъектами различных угроз, — имели доступ к этой технологии", — сказал вице-президент Microsoft по безопасности клиентов Том Берт в интервью Reuters перед публикацией отчета.

Представители российской, северокорейской и иранской дипломатий не сразу ответили на сообщения с просьбой прокомментировать эти обвинения.

Представитель посольства Китая в США Лю Пэнъюй заявил, что Китай выступает против "беспочвенной клеветы и обвинений в адрес Китая" и выступает за "безопасное, надежное и контролируемое" внедрение технологий ИИ для "повышения общего благосостояния всего человечества".

Утверждение о том, что поддерживаемые государством хакеры были пойманы на использовании инструментов ИИ для расширения своих шпионских возможностей, вероятно, подчеркнет опасения по поводу быстрого распространения этой технологии и ее потенциала для злоупотреблений. Высокопоставленные чиновники по кибербезопасности на Западе с прошлого года предупреждали, что злоумышленники используют такие инструменты, хотя конкретные данные до сих пор были скудными.

"Это один из первых, если не первый, случай, когда компания, занимающаяся разработкой ИИ, публично обсуждает, как субъекты кибербезопасности используют технологии ИИ", — сказал Боб Ротстед, возглавляющий отдел анализа угроз кибербезопасности в OpenAI.

Хакеры, предположительно работающие от имени российского военного шпионского агентства, известного как ГРУ, использовали модели для изучения "различных спутниковых и радарных технологий, которые могут относиться к обычным военным операциям на Украине", говорится в сообщении Microsoft.

По словам Microsoft, северокорейские хакеры использовали модели для создания контента, "который, вероятно, использовался в фишинговых кампаниях" против региональных экспертов.

Иранские хакеры также использовали модели для написания более убедительных писем, в частности, с их помощью они составили сообщение, в котором пытались заманить "видных феминисток" на сайт-ловушку.

Хакеры, поддерживаемые китайским государством, также экспериментировали с большими языковыми моделями, например, чтобы задавать вопросы о конкурирующих спецслужбах, проблемах кибербезопасности и "выдающихся личностях".